दिल्ली : आर्टिफिशियल इंटेलिजेंस (एआई) और मशीन लर्निंग (एमएल) पर आधारित टेक्नोलॉजी ने हाल के वर्षों में क्षमता, पहुंच और व्यापक तैनाती में बहुत वृद्धि देखी है और उनकी वृद्धि में कमी का कोई संकेत नहीं है. जबकि सबसे अधिक दिखाई देने वाली एआई तकनीक का विपणन किया जाता है लर्निंग-आधारित तरीकों को पर्दे के पीछे व्यापक रूप से नियोजित करने के लिए. डिजिटल मानचित्रों पर मार्ग-खोज से लेकर भाषा अनुवाद, राजनीतिक अभियान के लिए बायोमेट्रिक पहचान और औद्योगिक प्रक्रिया प्रबंधन से लेकर खाद्य आपूर्ति रसद (लॉजिस्टिक्स), बैंकिंग और वित्त से लेकर स्वास्थ्य सेवा तक, एआई हर सूरत में वर्तमान से जुड़ी दुनिया को परिपूर्ण करता है.

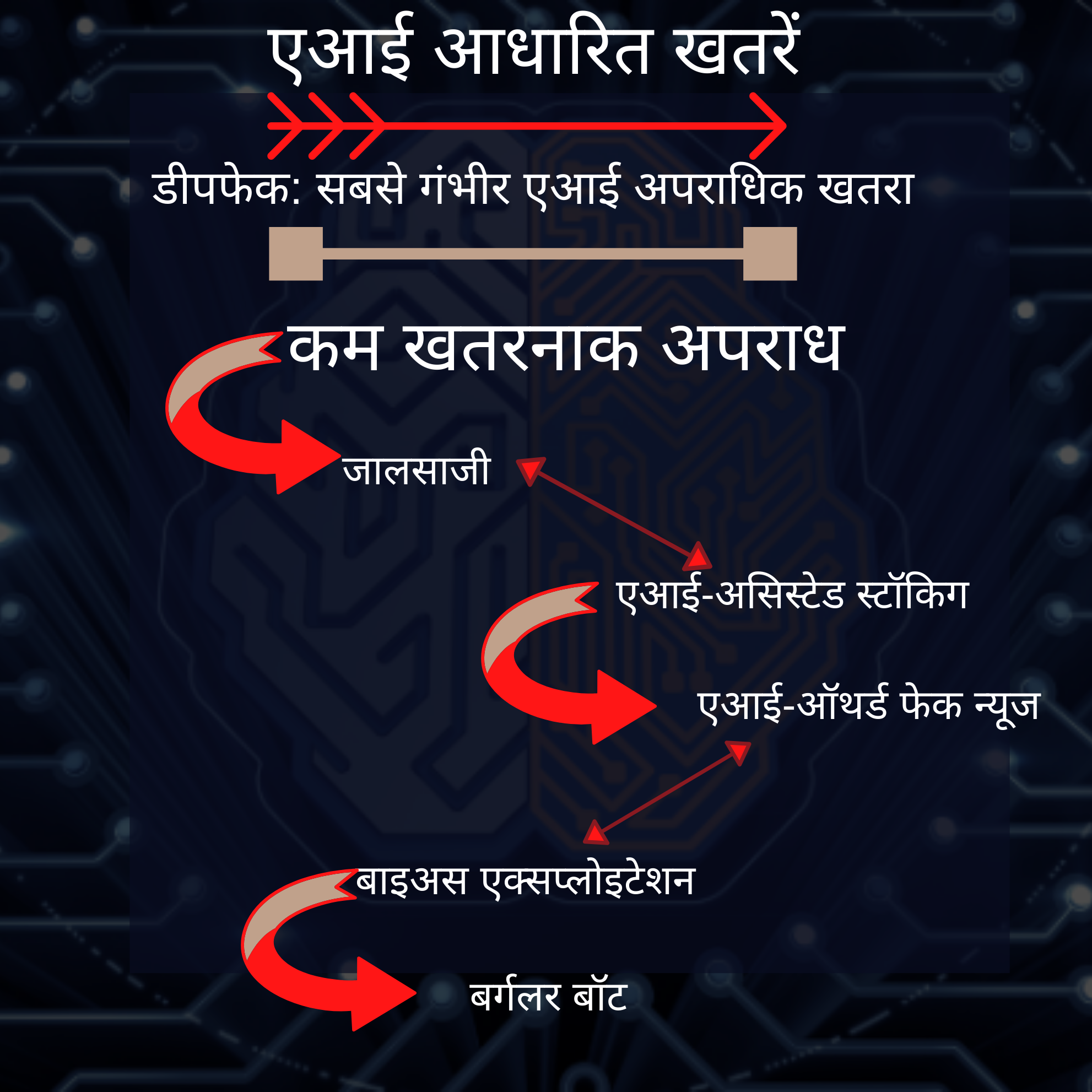

कर्नल इंद्रजीत बताते हैं कि एआई क्राइम के सबसे गंभीर खतरे में डीपफेक को गिना जाता है, इसके अलावा सभी उत्पादों के उपयोग मामलों के लिए एआई पहचान आधारित साइबर क्राइम जैसे धोखाधड़ी, डीपफेक या सिंथेटिक छवियों और डीपफेक वीडियो पर आधारित हैं, जो पहले से ही बढ़ रहा है.

डीपफेक, धोखेबाजों द्वारा इस्तेमाल की जा रही सबसे तेज रणनीति है. धोखाधड़ी करने वाले अब नए खाते खोलने के लिए सिंथेटिक पहचान की ओर रुख कर रहे हैं. किसी भी व्यक्ति की पहचान पूरी तरह से फेक हो सकती है या गलत सूचनाओं का एक अनूठा समामेलन हो सकती है, जो चोरी किया गया हो. व्यक्तिगत पहचान सूचना (पीआईआई) को किसी डेटाबेस से हैक किया जा सकता है (किसी अप्रतिष्ठित व्यक्ति से प्राप्त) या डार्क वेब से खरीदा जा सकता है. जिनके पीआईआई से समझौता या चोरी हो गई है, उन पर सीमित प्रभाव के कारण, अक्सर पारंपरिक पहचान धोखाधड़ी की तुलना में इस तरह के धोखाधड़ी पर अधिक समय तक किसी का ध्यान नहीं जाएगा.

आर्टिफिशियल इंटेलिजेंस का उपयोग करके बड़ी सटीकता से किसी व्यक्ति की उपस्थिति को डिजिटल रूप से फिर से बनाने का परिणाम डीपफेक है, यह व्यक्ति को इस प्रकार सक्षम बनाता है कि वह किसी व्यक्ति से ऐसा कुछ कहलाता है जो उन्होंने कभी नहीं कहा, या किसी ऐसे जगह पर दिखाता है जहां वे कभी नहीं रहे हैं. यूट्यूब अलग-अलग गुणवत्ता के उदाहरणों के साथ व्याप्त है, लेकिन यह देखना आसान है कि कैसे एक अच्छी तरह से बनाया गया डीपफेक किसी ऐसे व्यक्ति के लिए हानिकारक हो सकता है, जिसे इसके लिए उपयोग किया जाता है.

डीपफेक को सबसे गंभीर आर्टिफिशियल इंटेलिजेंस (एआई) अपराध खतरों में से एक नंबर पर रैंक किया गया है, क्योंकि आवेदनों की विस्तृत सारणी के आधार पर इसका उपयोग आपराधिक गतिविधियों और आतंकवाद के लिए किया जा सकता है.

जब यह शब्द पहली बार गढ़ा गया था, तो गहरे विचार ने व्यापक रूप से इसे चिंता का विषय बना दिया था, क्योंकि ज्यादातर गलत सूचना फैलाने में इस तकनीक का दुरुपयोग होता था खासकर राजनीति में. एक और चिंता जो खराब अभिनेताओं के इर्द-गिर्द घूमती है और एक्सटॉर्शन, ब्लैकमेल और वित्तीय लाभ में धोखाधड़ी के लिए डीपफेक का उपयोग करती है.

डीपफेक और सिंथेटिक एआई-सक्षम तकनीक का उदय, इन सिंथेटिक पहचानों के लिए लोगों की असली दिखने वाली तस्वीरें या वीडियो को जनरेट करना, धोखेबाजों के लिए गंभीर स्तर की धोखाधड़ी करने को आसान बनाता है. बहुत सारे मोबाइल एप हैं जो लोगों को भी वीडियो में और यहां तक कि वायरल मीडिया कन्टेंट में बदलकर मशहूर हस्तियों के चेहरे को अपने साथ बदलने की अनुमति देते हैं.

फेक ऑडियो या वीडियो सामग्री को विशेषज्ञों द्वारा साइबर खुफिया या साइबर आतंकवाद के लिए अपने संभावित अनुप्रयोगों के संदर्भ में आर्टिफिशियल इंटेलिजेंस के सबसे चिंताजनक उपयोग के रूप में स्थान दिया गया है, यूनिवर्सिटी कॉलेज लंदन के शोधकर्ताओं ने एक रैंकिंग जारी की है, जिसमें विशेषज्ञों के अनुसार इसे सबसे गंभीर एआई अपराधिक खतरा माना गया है.

अपराध विज्ञान में प्रकाशित और यूसीएल में भविष्य के अपराध के लिए Dawes केंद्र द्वारा वित्त पोषित एक अध्ययन के अनुसार (और एक नीति ब्रीफिंग के रूप में उपलब्ध), अगले 15 वर्षों में अपराध को सुविधाजनक बनाने के लिए एआई के 20 तरीकों की पहचान की जा सकती है, इन्हें चिंता के क्रम में रैंक किया गया था जैसे नुकसान के कारण, आपराधिक लाभ या लाभ के लिए उनकी क्षमता, वह कितना आसान होगा और उनको रोकना कितना मुश्किल होगा.

अधिकांश चिंतित विषय ऑडियो/वीडियो प्रतिरूपण हैं, इसके बाद अनुरूपित फिशिंग अभियानों और चालक रहित वाहनों को हथियार के रूप में इस्तेमाल किया जाना. नकली कन्टेंट का पता लगाना और उसे रोकना मुश्किल होगा और इसके लिए कई तरह के उद्देश्य हो सकते हैं, जैसे एक सार्वजनिक व्यक्ति को बदनाम करने से लेकर वीडियो कॉल में एक जोड़े के बेटे या बेटी को प्रतिरूपित करके धन निकालने तक. इस तरह के कन्टेंट से ऑडियो और विजुअल सबूत व्यापक रूप से अविश्वास हो सकते हैं, जो स्वयं सामाजिक रूप से नुकसानदायक होगा.

कर्नल इंद्रजीत आगे बताते हैं नकली कन्टेंट के निर्माण के अलावा, पांच अन्य एआई- सक्षम अपराधों को बहुत अधिक चिंता का विषय माना जाता है, जो इस प्रकार हैं- ड्राइवर रहित वाहनों को हथियार के रूप में इस्तेमाल करना, लगातार स्पीर-फिशिंग हमलों का निर्माण, एआई सिस्टम नियंत्रित को अक्षम करना, बड़े पैमाने पर ब्लैकमेल करने के प्रयोजनों के लिए ऑनलाइन जानकारी की कटाई और एआई-आथर्ड फर्जी समाचार. जबकि सबसे कम चिंताजनक खतरे में से कुछ इस प्रकार हैं- जालसाजी, एआई-आथर्ड की नकली समीक्षा और एआई-असिस्टेड स्टॉकिंग शामिल हैं.

कई पारंपरिक अपराधों के विपरीत, डिजिटल क्षेत्र में अपराधों को आसानी से साझा किया जा सकता है और दोहराया जा सकता है, यहां तक कि बेचा भी जा सकता है, जिससे आपराधिक तकनीकों का विपणन किया जा सकता है और अपराध को सेवा के रूप में प्रदान किया जा सकता है. इसका मतलब है कि अपराधी अपने एआई- आधारित अपराध के अधिक चुनौतीपूर्ण पहलुओं को आउटसोर्स करने में सक्षम हो सकते हैं. इन अपराधों को निम्न, मध्यम या उच्च खतरों के रूप में वर्गीकृत किया जा सकता है.

कम खतरे: कम खतरे अपराधियों के लिए कुछ लाभ देते हैं, क्योंकि वे थोड़ा नुकसान पहुंचाते हैं और उनसे छोटे लाभ लाते हैं. आमतौर पर इनसे कम फायदा होता है और नुकसान के लिए अपेक्षाकृत सरल होते हैं. आरोही क्रम में, इन खतरों में जालसाजी, फिर एआई-असिस्टेड स्टॉकिंग, एआई-आथर्ड फर्जी समाचार के कुछ रूप और अंत में बाइअस एक्स्प्लॉइटेशन (या प्लेटफॉर्म एल्गोरिदम का दुर्भावनापूर्ण उपयोग), बर्गलर बॉट (पर्याप्त एआई के साथ छोटे ड्रोन) (ब्रेक-इन कुंजियां चुराना या दरवाजे खोलना) और एआई सिस्टम द्वारा पता लगाने से बचना.

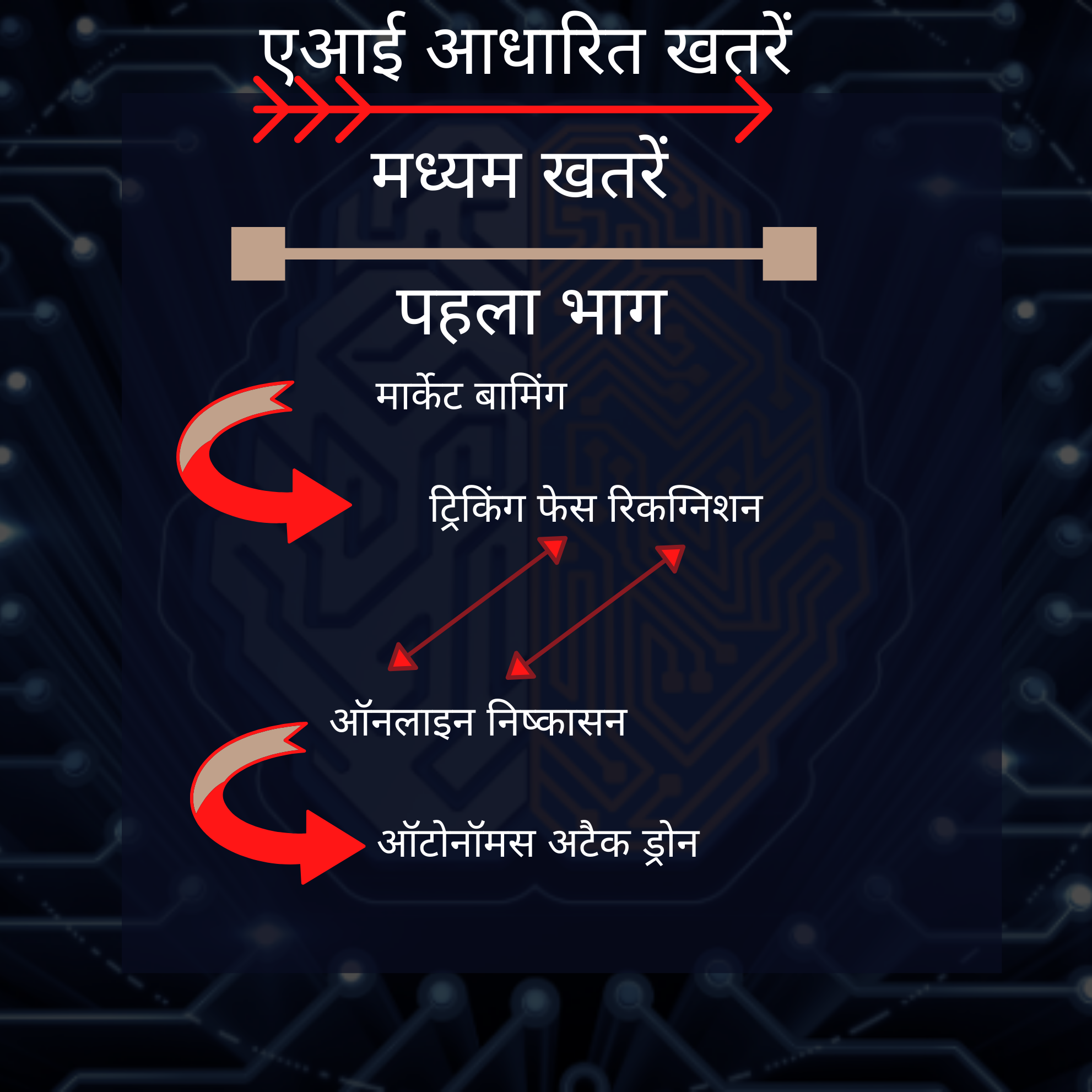

मध्यम (मॉडरेट) खतरे: ये खतरे आम तौर पर और अधिक तटस्थ हो गए, चार विचारों के साथ औसतन अपराधी के लिए यह न तो अच्छा और न ही बुरा, कुछ आउटलेर के साथ जो अभी भी संतुलित है.

इन आठ खतरों को गंभीरता के दो भागों में विभाजित किया गया था.

पहला भाग

- मार्केट बॉम्बिंग (जहां वित्तीय बाजारों में व्यापार पैटर्न द्वारा हेरफेर किया जाता है)

- ट्रिकिंग फेस रिकग्निशन

- ऑनलाइन एविक्शन (या आवश्यक ऑनलाइन सेवाओं तक पहुंच से किसी को रोकना)

- तस्करी और परिवहन व्यवधान के लिए ऑटोनॉमस ड्रोन हमला.

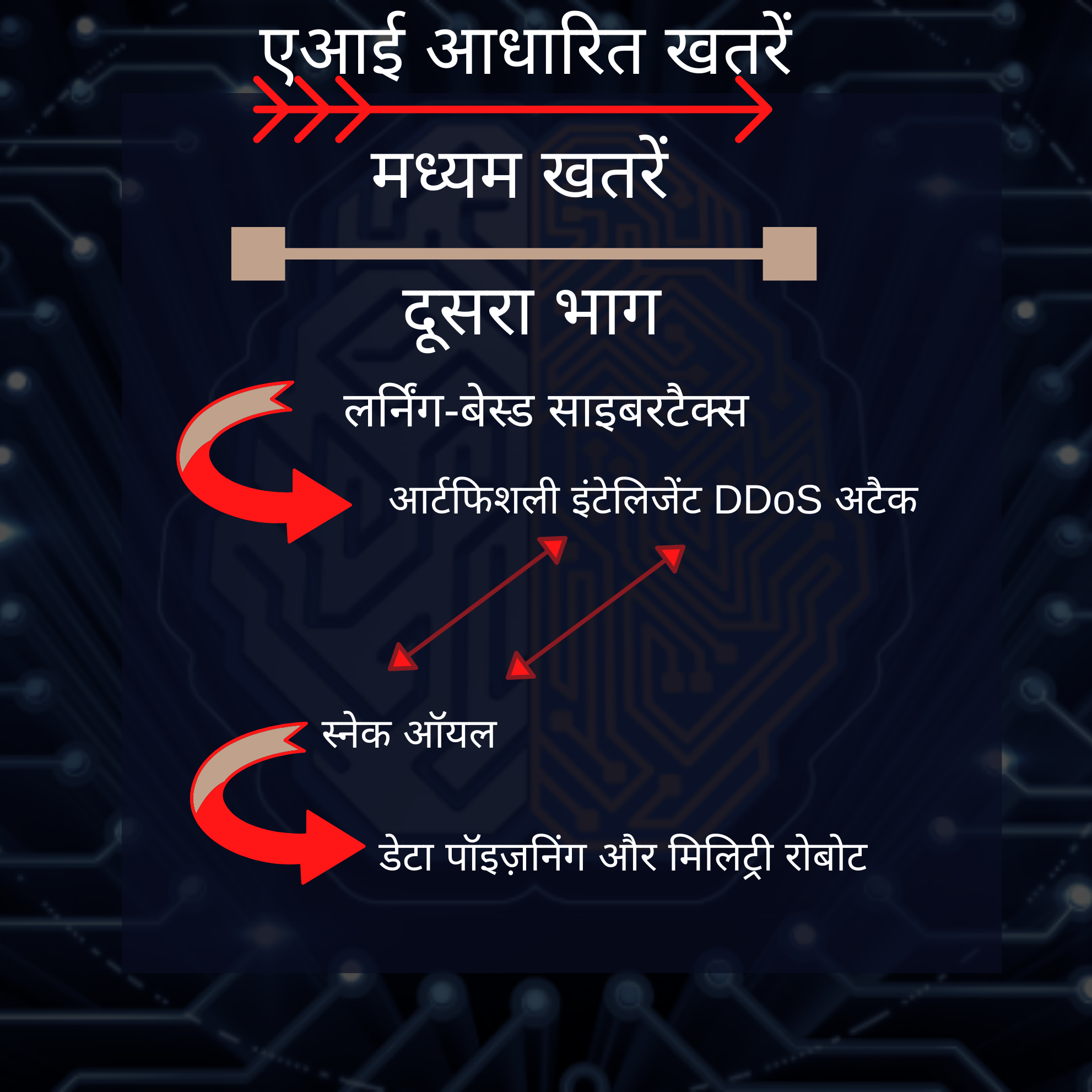

मध्यम खतरे में दूसरा भाग

- लर्निंग-बेस्ड साइबरटैक्स

- आर्टिफिशियल इंटेलिजेंस DDoS अटैक

- स्नेक ऑयल, जहां नकली एआई को एक गलत सेवा के एक भाग के रूप में बेचा जाता है

- डाटा पॉइज़निंग और मिलिट्री रोबोट

मशीन-लर्निंग प्रोग्राम में झूठा डाटा और स्वायत्त युद्धक्षेत्र उपकरण का अधिग्रहण, दोनों कुछ गंभीर चिंताएं पैदा कर सकते हैं.

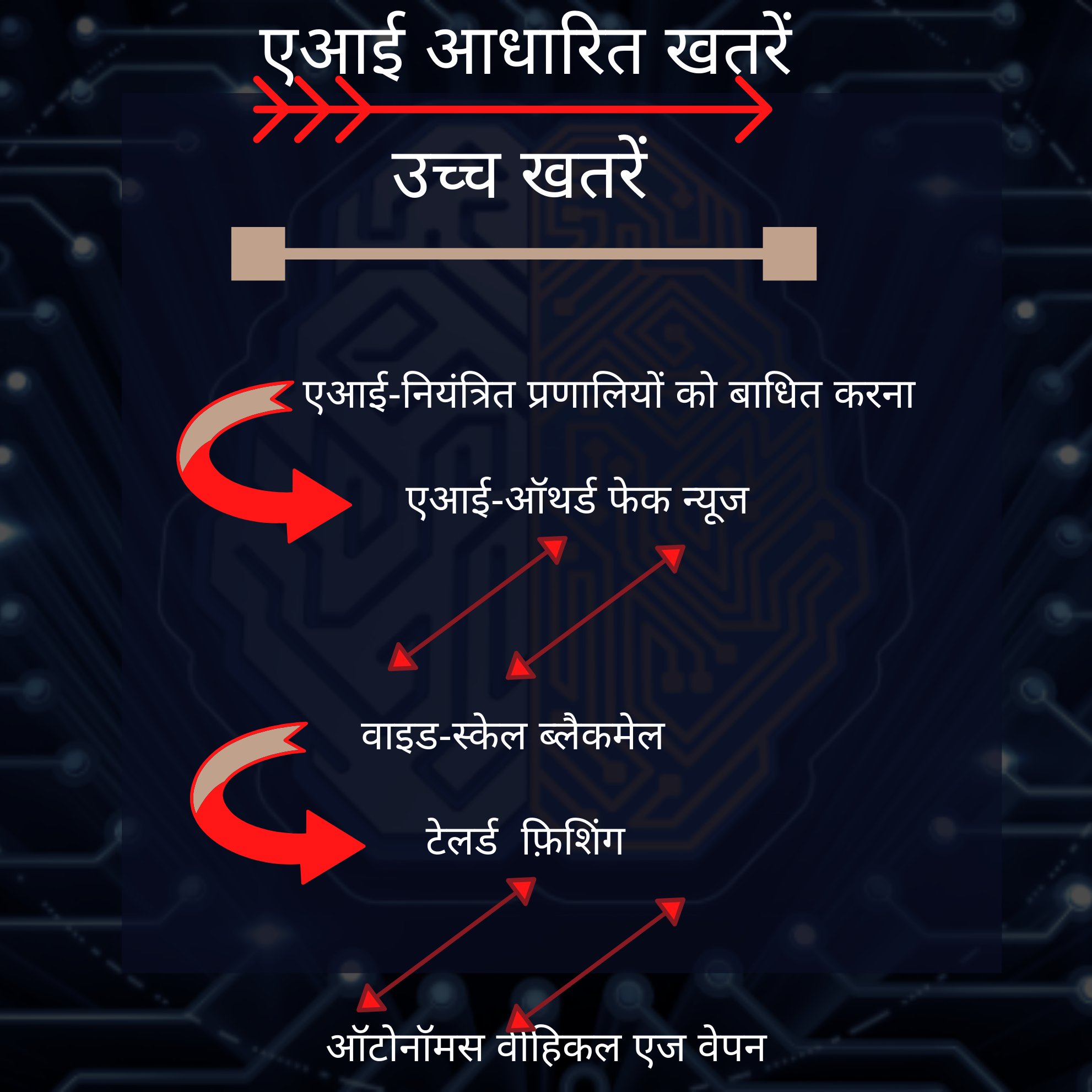

उच्च खतरे: अंत में, बहुत सारे खतरे थे, जिन्हें विशेषज्ञों की टीमों द्वारा बहुत अधिक स्थान दिया गया था.

- एआई-नियंत्रित प्रणालियों को बाधित करना

- भड़काऊ एआई-ऑथर्ड फेक न्यूज

- वाइड-स्केल ब्लैकमेल

- टेलर्ड फिशिंग (या जिसे हम आमतौर पर भाला फिशिंग के रूप में वर्णित करते हैं)

- ऑटोनॉमस वाहनों का उपयोग हथियार के रूप में किया गया था

सभी चार विचारों में अपराधी के लिए सबसे अधिक फायदेमंद होने वाले खतरे में ऑडियो / विजुअल इंपर्सनेशन का उपयोग किया गया, जिसे आमतौर पर डीपफेक के रूप में संदर्भित किया जाता है.

कर्नल इंद्रजीत कहते हैं कुछ खतरों के कारण - जैसे डीपफेक - दूसरों की तुलना में बहुत अधिक प्रभावशाली हैं, इसका मतलब यह नहीं है कि आप इन अन्य खतरों को अनदेखा कर सकते हैं. वास्तव में, सच्चाई इसके विपरीत है. किसी का शब्द आपके मुंह में डाला जाए तो स्पष्ट रूप से यह हानिकारक है, यह ऑनलाइन साझा की गई नकारात्मक समीक्षाओं का वर्गीकरण करने के लिए भी बहुत हानिकारक हो सकता है, चाहे वे एआई द्वारा उत्पन्न किए गए थे या नहीं.

ऑनलाइन दुनिया में, व्यापार के अवसर बड़े पैमाने पर तेजी से इंटरनेट की ओर पलायन कर रहे हैं. परिणामस्वरूप, आपको यह सुनिश्चित करने की आवश्यकता है कि आपका व्यवसाय सभी प्रकार के ऑनलाइन खतरों से सुरक्षित है - फिर चाहे इसमें एआई शामिल हो.

आप कर्नल इंद्रजीत को ट्विटर @inderbarara पर और इंस्टाग्राम पर inderbarara पर फॉलो कर सकते हैं.